本記事は、IT業界での実務経験を持つ筆者が、公開情報・業界レポート・実際の利用経験をもとに整理したものです。 AI技術は日々変化しているため、内容は執筆時点(2026年2月時点)の情報に基づいています。

特にセキュリティ・法務・金融などの領域に関わる判断については、必ず公式情報および専門家の確認を推奨します。

AI技術の急速な普及は、ビジネスの効率化をもたらす一方で、新たなセキュリティリスクも生み出しています。 2026年現在、企業が直面するAI関連の脅威は「生成AIを使った詐欺」「AIシステムへの攻撃」「データ漏洩」の3方向で急速に高度化しています。 本記事では、公開されている業界レポートや技術資料、実際のAI利用経験をもとに企業が知っておくべきAIセキュリティリスクと実践的な対策を解説します。

特に「社内でChatGPTやClaudeを導入し始めた企業担当者」「情報システム部門」「管理職」の方は必読です。

2026年のAIセキュリティリスク概要

Gartnerは、AIリスク管理不足に関連する訴訟増加の可能性について警告しています。。医療診断ミス・自動運転事故・採用での不当な差別など、影響範囲は産業全体に広がっています。

また、業界調査ではディープフェイク対策投資の増加が予測されています。

参考: Gartner公式プレスリリース

OWASP Top 10 for LLM Applications

ディープフェイクによる詐欺・なりすまし

ディープフェイクとは、AIを使って人物の顔や声を精巧に偽造する技術です。この技術は「ビジネスメール詐欺(BEC)」と組み合わさった新しい手口として企業を狙っています。

典型的な手口として、CEOや役員の声をAIで生成し、経理担当者に「緊急送金」を指示するケースが増加しています。欧米では実被害が続出しており、日本企業も対岸の火事ではありません。

プロンプトインジェクション攻撃

プロンプトインジェクションとは、AIシステムへの悪意ある指示(プロンプト)を注入することで、AIに意図しない動作をさせる攻撃手法です。企業がAIエージェントや社内チャットボットを導入するにあたり、この脆弱性が新たな脅威となっています。

具体的な攻撃パターン

- 直接注入:ユーザーが直接AIに悪意ある指示を与えてシステムを乗っ取る

- 間接注入:Webページやドキュメント内に隠れた指示を埋め込み、AIが読み込んだ際に実行させる

- 脱獄(Jailbreak):AIの安全フィルターを迂回させる特殊なプロンプトを使用する

AIを悪用したサイバー攻撃の高度化

攻撃者もAIを活用しており、フィッシングメールの精度向上・マルウェアの自動生成・脆弱性スキャンの自動化などが現実の脅威となっています。 従来のセキュリティツールでは検知が難しいケースも増えており、AI対AIの「セキュリティ戦争」が始まっています。

すべてのエージェントは、人間と同等のセキュリティ保護を備えるべきです。そうすることで、エージェントが野放しのリスクを抱えた存在になることを防げます。

企業が今すぐ取るべき対策

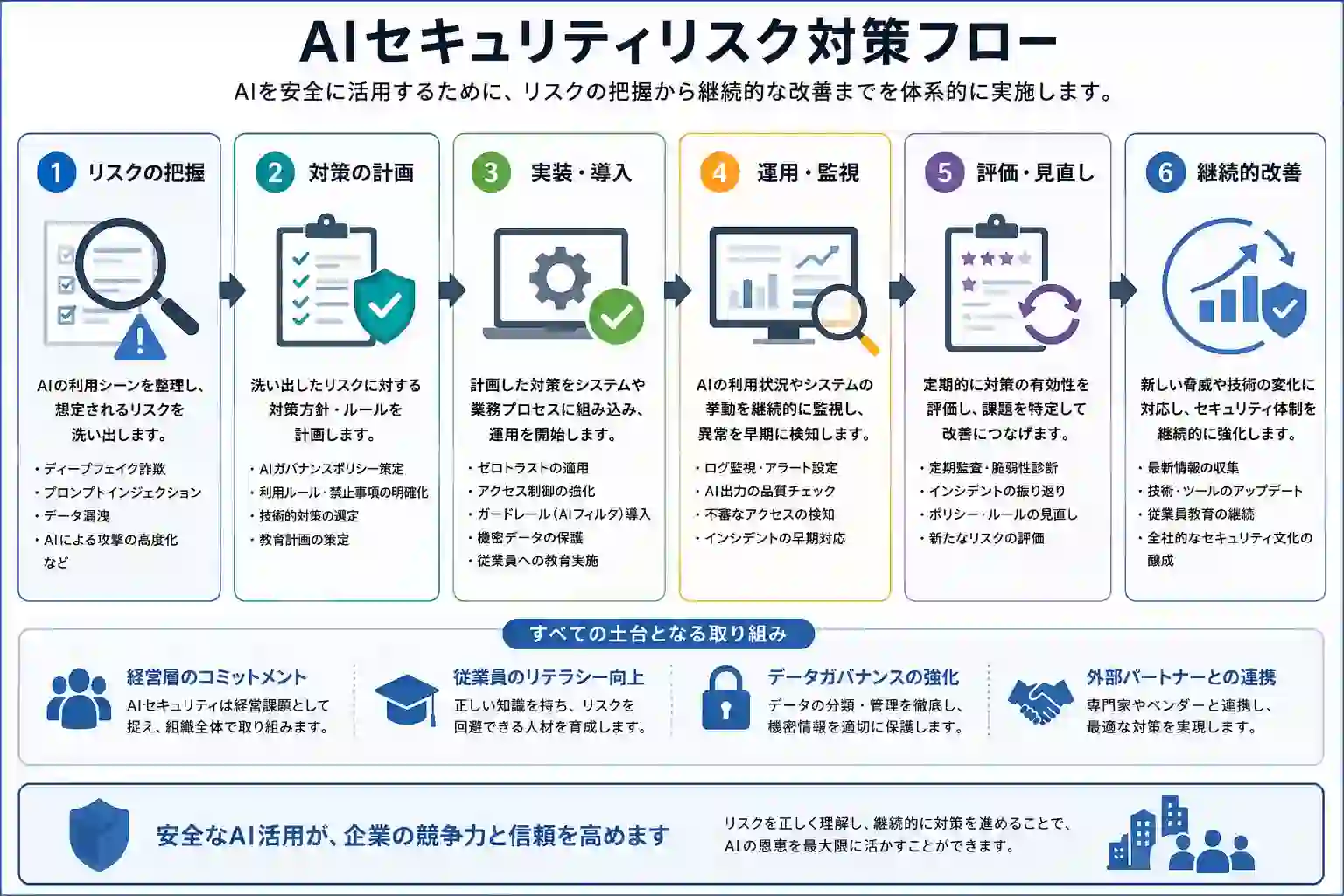

AIセキュリティリスクに対応するために、企業は以下の対策を優先的に実施することが推奨されます。

- AIガバナンスポリシーの策定:社内でAIを使用する際のルール・禁止事項を明文化する

- 従業員教育:ディープフェイク詐欺・フィッシングへの対応訓練を実施する

- ゼロトラストアーキテクチャ:AIエージェントにも最小権限の原則を適用する

- AIシステムの定期監査:AIの出力を人間がチェックする仕組みを導入する

- 機密コンピューティングの活用:処理中のデータも暗号化して漏洩リスクを低減する

私が考えるセキュリティフローは下図の通りです。

まとめ

AIセキュリティリスクは「使う側」と「攻撃する側」の両方で急速に高度化しています。実際の現場では、 「便利だから導入する」だけでは事故を防げない段階に入っています。 まずはAIガバナンスポリシーの整備と従業員教育から着手し、段階的に技術的対策を強化していきましょう。

よくある質問(FAQ)

Q1. 2026年に懸念される最大のAIリスクは何ですか?

A. ディープフェイクを用いたなりすまし詐欺、AIシステム特有の脆弱性を突くプロンプトインジェクション、そしてAIにより自動化・高度化されたサイバー攻撃が主な脅威です。

Q2. 企業がAIセキュリティのためにまず取り組むべきことは?

A. 技術的な対策の前に、社内でのAI利用ルールを定めた「ガバナンスポリシーの策定」と、従業員のリテラシー向上を目的とした「教育」が最優先事項となります。

Q3. 社内で無料のAIツール(ChatGPT等)を使う際の注意点は?

A. 入力データがAIの学習に再利用されることによる「機密漏洩リスク」が最大の問題です。法人向けプランの契約や、学習に利用させない設定(オプトアウト)の徹底が不可欠です。

Q4. プロンプトインジェクションへの技術的な防御策はありますか?

A. 2026年現在、完全に防ぐ手法は確立されていませんが、AIへの命令とデータを分離する設計や、出力を別のAIで検閲する「ガードレール」の導入が有効な対策とされています。

Q5. AIによる事故は従来のサイバー保険で補償されますか?

A. 従来の保険ではAI特有の権利侵害やアルゴリズムの誤作動をカバーしきれないケースがあります。2026年最新の「AI特化型保険」への見直しや特約の追加を検討してください。

【実体験】「AI便利だから」で情報漏洩しかけた話

本記事の一部内容には、筆者自身が実際にAIツールを業務・検証目的で使用した経験が含まれています。

実務環境では、理論上のリスクだけでなく「現場で起きるヒューマンエラー」が最も大きなリスクになるケースが多く、 その観点からも本記事を構成しています。

※個人情報・機密情報は含まず、再現可能な範囲で記述しています。

実は先日、私自身が「AIの便利さ」に負けて、重大なミスを犯しそうになりました。

社内向けの会議資料を作成している時に、顧客名や具体的な予算数字が入ったメモをそのまま無料版のChatGPTに貼り付けてしまったのです。

貼りつけた後に、「無料版は学習データに利用される可能性がある設定だった!」と気づき、慌てて削除しました。 多くのAIツールが普及していますが、「入力データがAIの学習に使われる可能性がある」という基本を、つい忘れてしまっていたのです。

もしそのまま送信していたら、将来的な情報漏洩リスクにつながる可能性がありました。

どれだけ高価なセキュリティソフトを導入していても、使う人間の「たった一回のコピペ」で全てが台無しになる。 AI時代のセキュリティは、結局のところ「個人のリテラシー」に依存しているのだと、痛感した出来事でした。 みなさんも気を付けてください!

参考情報・出典

※本記事の情報は2026年時点の公開情報・業界資料をもとに整理しています。 実際の導入判断は専門家へご相談ください。